ООО Технология Чэнду Сюньцзитун

Китай: как регистрируют и хранят данные на заводах?

2026-02-06

- От бумаги к битам: эволюция носителя

- Не просто хранилище: структура и логика базы данных

- Провалы в передаче и локальные буферы

- Кейс: внедрение системы мониторинга температуры в литейном цеху

- Безопасность и доступ: кто и как работает с данными

- Вместо заключения: данные как сырье для цифрового двойника

Когда слышишь про ?регистрацию данных на производстве?, многие сразу представляют себе гигантские серверные, облака и сложные ERP-системы. На практике же, особенно на средних и небольших предприятиях, всё часто начинается с элементарных Excel-табличек и ручных журналов. И этот разрыв между представлением и реальностью — ключевая точка, где и рождаются все сложности.

От бумаги к битам: эволюция носителя

Лет десять назад стандартом де-факто были бумажные контрольные карты. Оператор записывал параметры — температуру, давление, время цикла — от руки. Потом эти листки сшивались в папки и отправлялись в архив, где благополучно пылились. Проблема была не только в поиске, но и в валидации данных. Человеческий фактор, размазанные чернила, потеря листка — обычное дело. Переломным моментом стало не появление какого-то супердорогого ПО, а массовый переход на смартфоны и дешёвые планшеты. Заметил, что на многих участках стали ставить старые Android-устройства в защитных корпусах, на которых открыта веб-форма для ввода. Это был первый, часто кустарный, шаг к цифре.

Сейчас же тренд — это промышленные IoT-шлюзы. Они стали значительно доступнее. Не то чтобы их ставили на каждую единицу оборудования, но на ключевые технологические узлы — обязательно. Суть в том, что датчик, например, термопара, через преобразователь передаёт сигнал не на отдельный самописец, а сразу на такой шлюз. Тот оцифровывает показания и отправляет их по Wi-Fi или, что надёжнее в цеху с помехами, по проводному Ethernet в локальный сервер. Это уже не ручной ввод, а автоматический сбор, что кардинально меняет дело.

Но и здесь есть подводные камни. Самый частый — протоколы обмена. Оборудование может быть старым, с аналоговым выходом 4-20 мА, или относительно новым, но с закрытым проприетарным протоколом типа Modbus RTU. Интеграция такого ?зоопарка? — отдельная головная боль. Часто требуется промежуточный контроллер или ПЛК, который будет агрегировать данные с нескольких источников, прежде чем отправить их дальше. В этом контексте интересен опыт некоторых интеграторов, например, ООО Технология Чэнду Сюньцзитун. На их сайте seadee.ru видно, что они как раз фокусируются на решении подобных задач ?стыковки? — у них в портфолио есть и беспроводные термометры, и системы мониторинга, что подразумевает работу с разнородными источниками данных. Их подход с использованием буферного механизма для надёжной передачи — это как раз практический ответ на проблему потерь данных в нестабильной цеховой сети.

Не просто хранилище: структура и логика базы данных

Многие ошибочно полагают, что собранные данные просто ?складываются? в базу. На деле, самая критичная часть — это тегирование. Каждому показанию должен быть присвоен уникальный тег (tag), который несёт в себе информацию: какой это агрегат (пресс №5), какой параметр (температура формы), единицы измерения, статус валидности. Без чёткой теговой структуры через полгода гигабайты данных превращаются в бесполезную кашу.

В Китае часто используют гибридный подход. ?Горячие? данные, необходимые для оперативного контроля (последние 3-6 месяцев), хранятся в высокопроизводительных промышленных СУБД, вроде TimescaleDB (на основе PostgreSQL) или специализированных PI System от OSIsoft. Они оптимизированы под временные ряды. Всё, что старше, мигрируется на более дешёвые носители, но не удаляется. Требования регуляторов, особенно в фармацевтике, пищепроме или аэрокосмисе, обязывают хранить полные истории параметров годами.

Здесь возникает тонкий момент с выбором. Готовые SCADA-системы часто идут со своей встроенной БД. Это удобно ?из коробки?, но может создать vendor lock-in и проблемы с масштабированием. Самописные решения на основе open-source (Grafana + InfluxDB) дают гибкость, но требуют серьёзной экспертизы для поддержки. Видел проекты, где начинали с самописного варианта, но из-за проблем с отказоустойчивостью и скоростью запросов переходили на коммерческие аналоги. Это всегда компромисс между бюджетом, кадрами и требованиями к надёжности.

Провалы в передаче и локальные буферы

Идеальной сети в цеху не существует. Помехи от мощного оборудования, вибрации, разрывы кабеля — это норма. Поэтому стратегия ?собрал и сразу отправил в облако? обречена на провал. Практически все адекватные системы сейчас используют многоуровневую буферизацию.

На уровне самого IoT-шлюза или контроллера есть энергонезависимая память (обычно от 64 Мб до нескольких Гб). Если связь с сервером пропала, данные пишутся туда. После восстановления соединения происходит синхронизация. Это базовый уровень. Второй уровень — это уже промежуточный сервер (часто его называют шлюзом или агрегатором) в цеховой серверной. Он принимает потоки данных со множества устройств, проводит первичную валидацию (отсев явных выбросов) и кэширует их перед отправкой в центральное хранилище или облако.

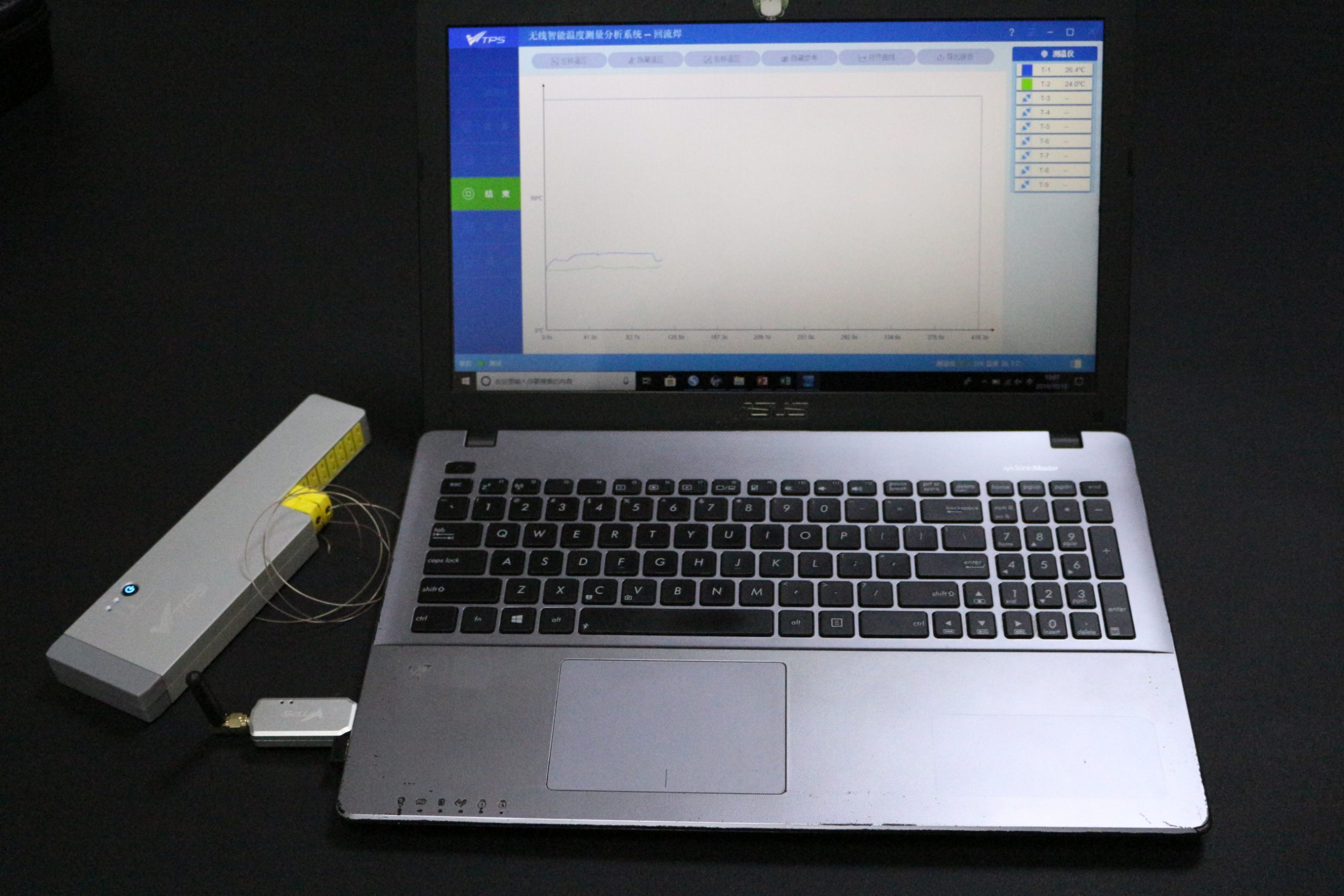

Как раз протокол, упомянутый у ООО Технология Чэнду Сюньцзитун — ?протокол надежной беспроводной передачи данных на основе буферного механизма? — из этой оперы. На практике это означает, что их устройства, вроде беспроводного тестера температуры печи, не просто шлют пакеты в эфир, а ожидают подтверждения о получении от принимающей стороны. Если подтверждения нет, пакет сохраняется и предпринимаются повторные попытки отправки. Это кажется очевидным, но многие дешёвые китайские датчики с радиомодулем LoRa или NB-IoT такого не делают, что приводит к потере критичных данных, например, при термообработке деталей в аэрокосмической отрасли.

Кейс: внедрение системы мониторинга температуры в литейном цеху

Расскажу на примере одного проекта, не идеального, но показательного. Задача была в мониторинге температурного поля в печах для литья по выплавляемым моделям. Раньше использовали громоздкие стационарные многоканальные самописцы с термопарами. Данные были, но их анализ занимал дни.

Решили перейти на беспроводные датчики. Выбор пал на систему, способную работать в высокотемпературной среде (до 1200°C) с автономностью не менее 72 часов. Ключевым был вопрос синхронизации времени. Если данные с разных печей и датчиков не имеют точной временной метки (с точностью до секунды или лучше), построить общую картину и анализировать корреляции невозможно. Использовали синхронизацию по внутренней сети NTP-сервером.

Сложности возникли на этапе установки антенн для приёма сигнала внутри металлического цеха. Пришлось экспериментировать с расположением точек доступа, фактически создавая сотовую структуру покрытия. Данные с датчиков стекались на локальный сервер, где ПО строило не просто графики, а тепловые карты печи в реальном времени, используя тот самый алгоритм отслеживания температурной кривой. Это уже следующий уровень — не просто сбор, а первичная аналитика на лету. Хранение же велось в реляционной базе с привязкой к ID каждой отливки, что потом позволяло по серийному номеру детали вытащить всю историю её термообработки.

Безопасность и доступ: кто и как работает с данными

Хранение — это полдела. Не менее важен доступ. На типичном заводе есть несколько уровней доступа: оператору участка — только данные с его линий за смену; начальнику цеха — сводные данные по цеху; технологу — доступ к историческим данным и инструментам для анализа; службе главного метролога — доступ к калибровочным коэффициентам и журналам поверок датчиков.

Часто эту систему ролей реализуют не через сложные AD-интеграции, а через простые учётные записи внутри самой MES (Manufacturing Execution System) или SCADA. Это создаёт уязвимость, но таков компромисс для простоты. Более продвинутые предприятия интегрируют учётные записи с корпоративной системой, используя, например, LDAP.

Отдельный вопрос — резервное копирование. Идеология ?3-2-1? (три копии данных, на двух разных типах носителей, одна из которых вне площадки) здесь тоже работает. Но в реальности часто ограничиваются ежедневным бэкапом с сервера цеха на физический жесткий диск в сейфе главного инженера. Вывоз за пределы завода, особенно если речь о данных, связанных с оборонным заказом, сопряжён с огромными бюрократическими сложностями. Поэтому ?облако? в чистом виде для таких данных часто неприменимо, используется схема приватного облака или гибридная модель, где на внешний сервер идут только агрегированные отчёты без детализации до секунды.

Вместо заключения: данные как сырье для цифрового двойника

Сейчас разговор о простом хранении постепенно уходит. Ценность данных — в их использовании для построения предиктивных моделей и цифровых двойников. Качественно собранные и сохранённые исторические данные по температуре, вибрации, потреблению энергии — это топливо для алгоритмов машинного обучения, которые могут предсказывать отказ оборудования или оптимизировать энергозатраты.

Но фундамент для этого — именно та рутинная, негламурная работа по настройке тегов, организации буферов, обеспечению целостности и синхронизации временных меток. Без этого все разговоры про ?Большие данные? и ?Индустрию 4.0? остаются просто разговорами. Как показывает практика, в том числе и опыт компаний-интеграторов, успех определяется не сложностью системы, а её надёжностью и приспособленностью к реальным, а не идеальным, условиям цеха. Именно на это и заточены многие современные решения, где акцент смещён с ?сбора любой ценой? на ?гарантированное получение и сохранение ключевых параметров?.